DOI:10.14186/j.cnki.1671-6620.2025.06.003

中图分类号:TF713

转炉终点控制是转炉炼钢的核心环节,其精度与稳定性直接决定着钢铁产品的质量水平和生产效益[1].传统转炉冶炼依靠人工经验来判断冶炼终点,效率和安全性均无法保证[2].与人工操作相比,计算机控制模型具有更高的准确性和安全性.目前,基于计算机控制的转炉模型主要包括静态模型和动态模型两类: 静态模型包括机理模型、增量模型、统计模型等;动态模型包括副枪模型、投弹模型、烟气模型等[3].国内某钢厂在实践应用中,将烟气分析技术与冶金机理建模相结合,构建了转炉冶炼终点预报控制系统.然而,受限于铁水成分与温度波动较大、 废钢添加量变化频繁以及辅料种类复杂等不利因素,该模型的终点碳温预测命中率始终难以提升,这导致补吹氧气的现象时有发生.根据现场统计数据,以目标温度±15 ℃、目标碳含量(质量分数,下同)±0.02%为命中标准,现有模型的终点温度命中率仅为59%,碳含量命中率也仅达66%.这一技术瓶颈的突破,需要引入具有更强泛化能力的机器学习方法.

机器学习[4]是人工智能的分支领域.在机器学习中,泛化能力是一个很重要的概念,指的是模型在处理未见过的数据时的表现能力.而集成学习[5]作为一种强泛化能力的机器学习方法,不仅可以充分利用多个学习器的互补性,有效避免单个学习器的过拟合问题,还能将多个模型的预测结果进行组合,得到比单个模型更加准确的预测结果,从而提高模型的泛化能力.Boosting 算法作为一种典型的集成学习方法[6],发展历程体现了机器学习技术的不断进步.Freund 等[7]最早提出了Boosting 算法,这是一种多项式级算法,能够将弱学习器提升为强学习器.Freund 和Schapire[8-9]在改进Boosting 算法的基础上,提出了自适应提升(adaptive boosting,AdaBoost)算法,它通过不断训练弱学习器,并根据前一轮训练结果对错误分类样本赋予更高权重,从而增加这些样本被选入下一轮训练集的概率,最终将多个弱学习器加权结合成更强大的模型.随着研究的深入,Boosting算法得到了广泛关注和应用,出现了许多改进版本.Friedman 等[10]提出的梯度提升算法(gradient boosting)采用残差方式训练弱学习器,其核心思想是使用前一轮模型预测值与实际观测值的残差作为新目标进行迭代训练.极端梯度提升(extreme gradient boosting,XGBoost)算法由Chen 等[11]提出,是一种高效的Boosting 算法,它采用二阶导数信息优化损失函数,并支持特征选择、树剪枝等技术.LightGBM 是微软开发的基于梯度提升框架的Boosting 算法,采用基于直方图的决策树算法,能高效处理大规模数据和高维特征.CatBoost 由Yandex 开发,具有自动处理缺失值、支持GPU 加速等特性,在处理含有大量类别特征的数据集时表现出色.

目前,Boosting 算法模型被广泛应用于冶金领域并取得了不错的成绩.徐猛等[12]使用改进的XGboost 模型对RH 精炼终点的钢水温度进行预测,在偏差为±5 ℃时,该模型命中率为92%.查伟等[13]将梯度提升算法用在真空自耗铸锭终点锰含量预测中,发现在整体误差范围内,该算法的预测效果较好.刘福龙等[14]采用CatBoost 算法对高炉铁水硫含量进行预测,发现该模型的各项评价指标均好于随机森林和BP 神经网络模型.基于此,本文中采用Adaboost,XGBoost,CatBoost 和 LightGBM 这 4 种典型Boosting 算法模型对国内某钢厂转炉冶炼终点的钢水碳含量和温度进行预测,并以各模型的RMSE(均方根误差)和命中率为标准进行比较,以期得出最优的算法模型.

选取国内某钢厂的铁水质量、铁水温度、废钢加入量、铁水中各元素(C,Si,Mn,P,S)含量、耗氧量及各辅料加入量等15 个变量作为模型特征参数输入,将终点钢水碳含量和温度作为模型输出进行建模.

在数据预处理过程中,某个特征参数的单个数据点可能出现异常情况.为保障数据样本的完整性与多样性,避免异常值干扰炉次正常特征参数的输入,需先剔除异常数据,再对缺失值进行均值填充.具体而言,针对每一列中的缺失值,先计算该列所有非缺失数据的平均值,再使用这个平均值来填充该列中的缺失值.CatBoost 模型具有自动填补缺失值的功能,故将数据剔除和均值填充操作只用于AdaBoost,LightGBM 和XGBoost 这3种模型的数据预处理中,以确保模型的稳定性和准确性.

为提高数据质量,需对原始数据进行两项关键处理:一是对特征参数实施小幅度随机扰动,以增强数据多样性;二是采用式(1)所示的数据归一化方法,将原始特征值通过线性缩放映射到[0,1]区间,消除不同特征因数值量纲差异对模型训练的影响.最终,将2 000 组数据按照8 ∶1 ∶1的比例随机划分为训练集、验证集和测试集,确保模型评估的全面性.

式中:Xn为归一化后的数据;Xi 为当前数据;Xmin和Xmax分别为数据最小值和最大值.

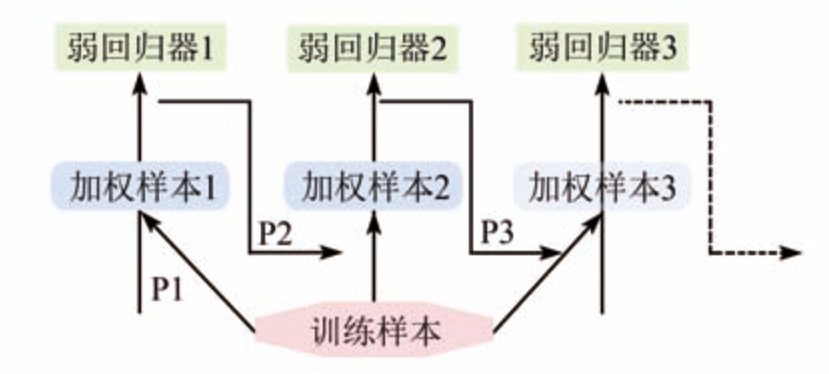

本研究中的4 种算法模型均属于Boosting 回归类算法,图1 示出了该算法迭代过程.

图1 Boosting 回归算法迭代过程

Fig.1 Iterative process of Boosting regression algorithm

更具体来讲,CatBoost,XGBoost 和LightGBM算法是3 种基于梯度提升决策树(gradient boosting decision tree,GBDT)[15]的改进算法.梯度提升算法通过串行训练回归树模型,同时采用梯度提升技术,不断优化模型的预测能力.在每一轮训练中,梯度提升算法会根据上一轮模型的残差来训练新的决策树模型,然后将新模型的预测结果与前几轮模型的结果相加,进而逐步改进模型的预测效果.

梯度提升算法的具体计算过程如下:

假设数据集D 有N 个样本,其中,每个样本的特征向量为xi,对应的标签为yi.

(1)定义损失函数.对于回归问题,常用的损失函数是平方误差损失函数L(y, f(x)),可表述为

式中: f(x)为待求的输出值,即模型预测值.

(2)初始化模型.假设有T 棵CART 树模型,每棵模型的输出为ft(x),初始化时设置为0.

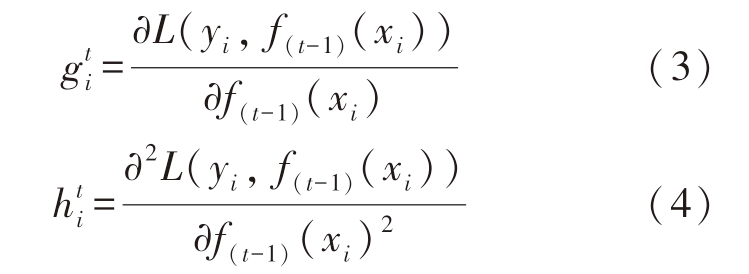

(3)迭代优化.对于第t 次迭代,计算模型的梯度和二阶导数.对于每个样本(xi, yi),损失函数的梯度和二阶导数分别为

式中:gti 为梯度;hti 为二阶导数;gj 为损失函数梯度.

(4)计算最优权重.先根据梯度和二阶导数计算出叶子节点的权重,然后将每个样本的梯度按其所属的叶子节点聚合,得到该叶子节点的梯度之和Gj 与二阶导数之和Hj.Gj 和Hj 的核心作用是计算叶子节点的最优权重Wj.

式中:Ij 为落在第j 个叶子节点中的样本集合;λ为正则化系数;gj 为损失函数的梯度.

(5)更新模型预测值.在第t 次迭代中,第j 个样本所属的叶子节点输出为

式中:η 为学习率.

由式(8)可知,在每次迭代中,将第j 个样本的预测值f(j-1)(xi)加上上一棵树模型输出的偏差,其中,偏差的大小由学习率和该叶子节点的权重决定.

(6)输出最终模型.将每个样本在所有决策树上的预测值相加,可表示为

在GBDT 的基础上,对3 种算法分别进行改进[16].CatBoost 算法的改进内容如下:①在CatBoost 算法处理分类特征时,采用基于对称二叉树的有序统计,并通过计算目标变量的加权平均值,实现对特征的有效编码;②通过学习缺失值的特点,自动为缺失值赋予合理的数值,无需额外的数据预处理步骤;③采用排序提升方法对抗训练集中的噪声,减轻梯度估计的偏差,进而解决预测偏移的问题;④引入了一种称为“类别乘积”的正则化技术,有效对抗过拟合问题.

XGBoost 算法的改进内容如下:①在损失函数中添加新的项,构建正则化以限制树的复杂度[见式(10)],避免模型在训练集上表现过好,而在测试集上的泛化性能较差;②采用更高效的近似直方图算法寻找最佳分裂点,减少树的构建时间并提高训练速度;③自定义损失函数和评估指标.

式中:λ(f)为正则化函数.

LightGBM 算法的改进内容如下:①使用基于直方图的决策树算法,将连续特征离散为直方图的方式,以降低训练和预测时间的复杂度;②采用一种被称为“按叶子节点”(leaf-wise)生长的策略,每次分裂时选择增益最大的叶子节点进行分裂,从而更快找到最优的分裂点,以提高模型的精度;③采用单边梯度采样的方法,从减少样本的角度出发,排除大部分小梯度的样本,仅用剩下的样本计算信息增益,以期在减少数据量和保证精度上取得平衡;④采用互斥特征捆绑的方式,将许多互斥的特征绑定为一个特征,达到特征降维的目的.

Adaboost 算法作为最先出现的Boosting 算法,与上述几种算法在基本思想上相似,但在计算细节上存在如下区别:Adaboost 直接通过真实值与当前模型预测值的差值定义残差,而GBDT 则基于当前与前序模型预测值的差异计算残差;Adaboost 采用动态样本权重调整机制,对分类错误的样本赋予更高权重以强化边界学习,GBDT 则通过梯度优化直接修正模型;在最终集成方式上,Adaboost 通过加权平均基础模型预测结果构建最终模型[17],GBDT 则采用简单加和集成所有基础模型的预测结果构建最终模型.

其具体计算过程如下:

(1)训练数据集并初始化样本权重.训练数据集D={(x1, y1),(x2, y2),…(xN, yN)}中包含N 个样本,每个样本权重的计算公式为

(2)训练基学习器.将一个弱回归器与样本权重结合起来进行训练,对于第t 轮训练,给定样本权重w1,t,w2,t…wn,t,则弱回归器的目标是最小化加权残差,如式(12)所示.

式中:y(it-1)为前t-1 个基学习器的预测值;ft(xi)为当前训练的弱回归器的预测值.

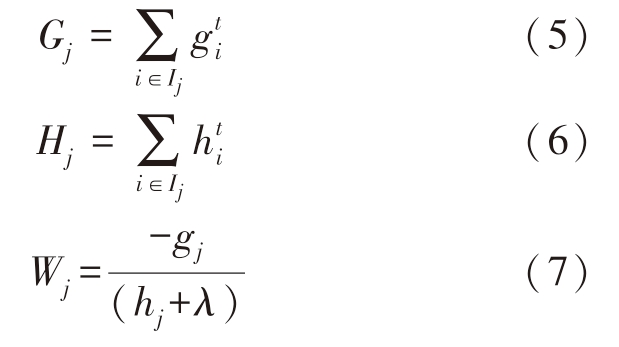

(3)计算加权分类误差率.对于第t 次迭代,计算弱回归器ht(x)的加权分类误差率errt 可表达为

(4)计算弱回归器ht(x)的权重wt[见式(3)].wt 值越大,弱回归器在当前样本权重下的重要性越高.

(5)更新样本权重.根据当前弱回归器的预测结果ht(xi)和样本权重w(i t),更新每个样本的权重w(i t+1),如式(15)~(16)所示.

式中:w(it+1)为样本i 在第t 次迭代中的权重;ht(xi)为第t 个弱回归器预测值;yi 为样本i 的预测值;η 为本轮迭代的学习率;Zt 为归一化因子,控制每个弱回归器的权重之和为1.

(6)弱回归器权重缩放.在每个迭代中,弱回归器权重需要缩放,才能用于正确计算最终权重.设学习率为η,则每个弱回归器的权重缩放系数为

较小的学习率表示每个弱回归器的权重被较小缩放,这会使所有弱回归器的贡献相对平衡;较大的学习率表示每个弱回归器的权重被较大缩放,这会更加重视预测误差较小的弱回归器.当采用较小的学习率时,每个弱回归器的权重更新幅度相对温和,这种渐进式调整使得所有基础模型的贡献趋于均衡;而较大的学习率则会显著放大每个弱回归器的权重缩放幅度,这种更新策略使得模型更加聚焦于那些预测误差较小的基础模型.

(7)输出结果.在迭代过程中,每个弱回归器的预测结果会对最终权重产生影响.将所有弱回归器的预测结果ht(x)乘以其权重wt,并将所有结果相加,即可得到最终的预测结果:

式中:T 为迭代次数.

Adaboost 算法在每一轮训练中会根据特征向量的相关性和影响程度,动态调整样本权重,以获得更优的输出结果.

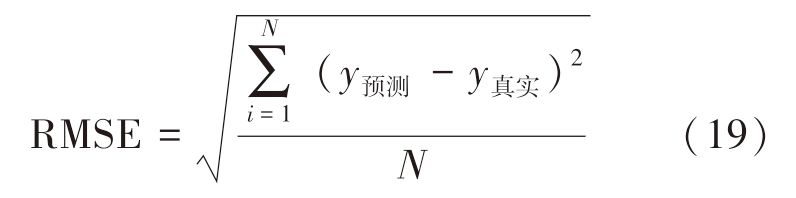

在机器学习中,超参数是训练模型之前手动设置的参数,如学习率、树的深度等.在模型构建过程中,超参数的选择对模型性能具有决定性影响,因此,需要通过系统化的优化方法寻找最佳超参数组合以提升模型性能[18].本研究采用随机搜索[19]与K 折交叉验证相结合的优化策略:随机搜索通过在预设的超参数空间中随机采样不同组合,探索潜在最优解,随着训练数据量的增加,该方法的搜索效率会逐步提升,能够有效避免局部最优陷阱[20-21];而K折交叉验证则通过将数据集划分为K 个子集,依次将每个子集作为验证集进行模型评估,计算验证集样本预测值与真实值的均方根误差(RMSE)作为评估指标[见式(19)].这种评估方式不仅提高了数据利用率,还能有效减少由数据划分偏差导致的评估误差.

式中:N 为样本数.

超参数寻优具体步骤如下:①确定超参数搜索范围;②随机打乱数据集;③将数据集划分为K 个互斥的子集(本模型中K =5);④选择其中1个子集作为验证集,剩下的K-1 个子集作为训练集;⑤用训练集对模型进行训练,并在验证集上进行评估; ⑥重复步骤③和④,直到每个子集都被用作验证集;⑦以每次验证结果的平均值作为最终的性能评估指标.

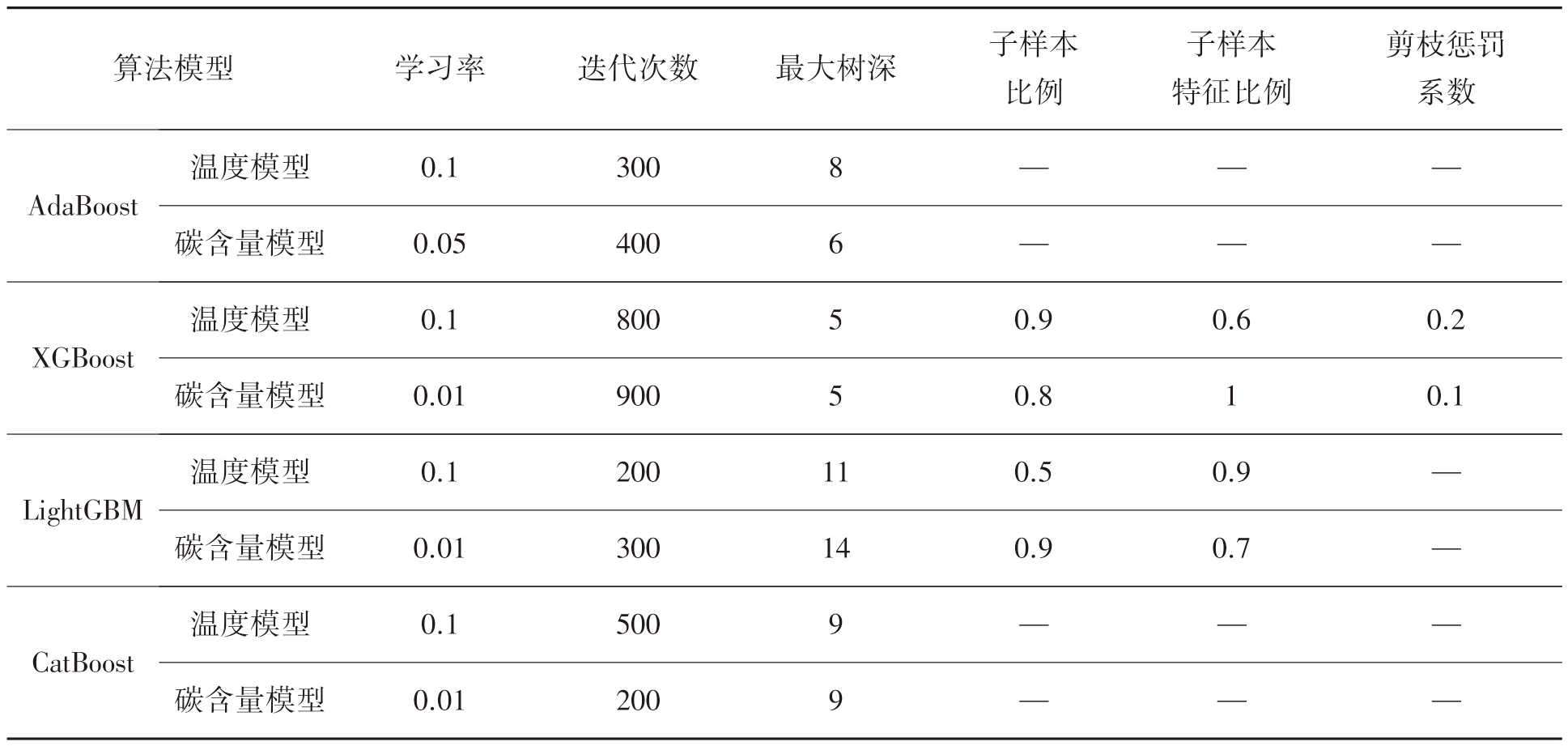

表1 列出了经过多次对比测试得出的各模型的最佳超参数组合.

表1 各算法最优超参数组合

Table 1 Optimal hyperparameter combinations for each model

算法模型学习率迭代次数最大树深子样本比例子样本特征比例剪枝惩罚系数温度模型0.13008——AdaBoost碳含量模型0.054006——XGBoost温度模型0.180050.90.60.2碳含量模型0.0190050.810.1温度模型0.1200110.50.9—LightGBM碳含量模型0.01300140.90.7—CatBoost温度模型0.15009——碳含量模型0.012009——

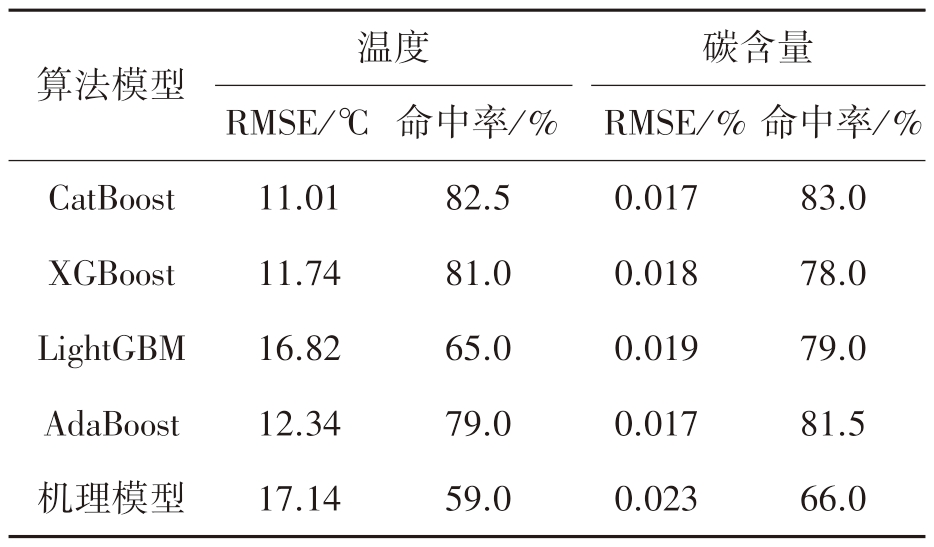

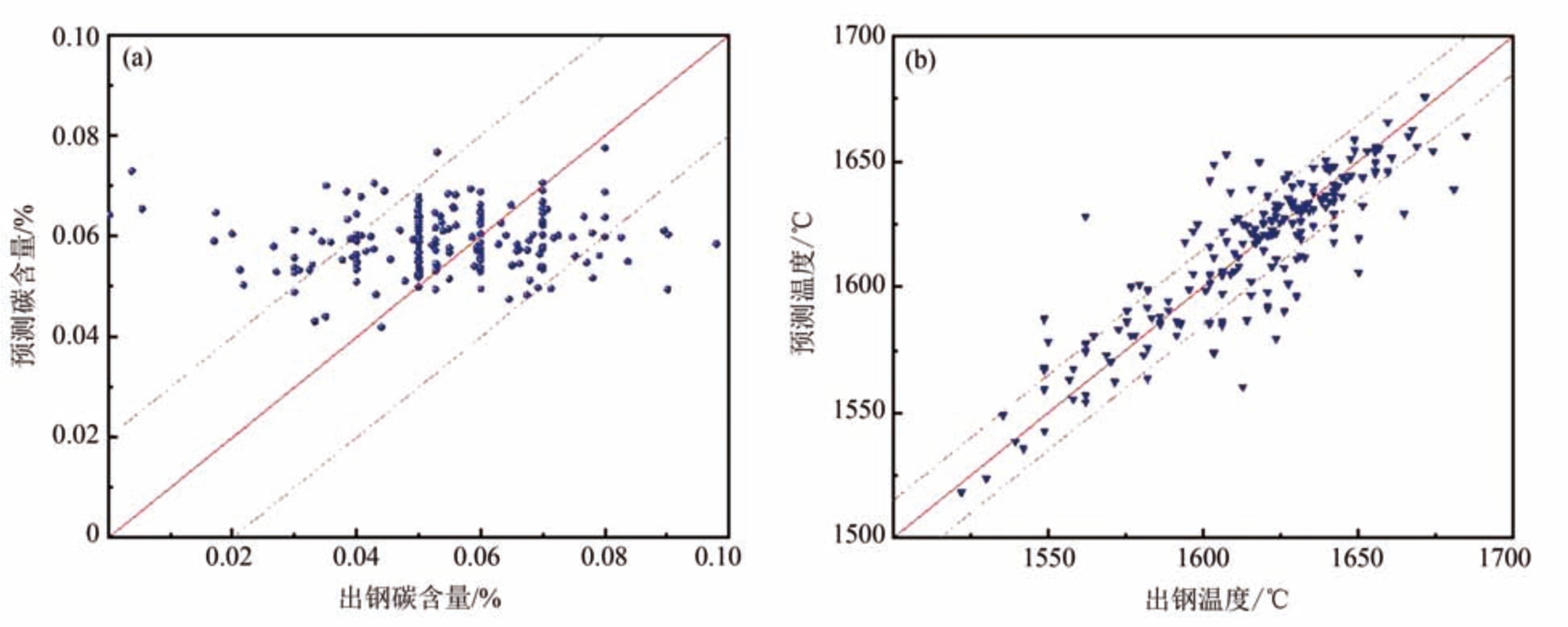

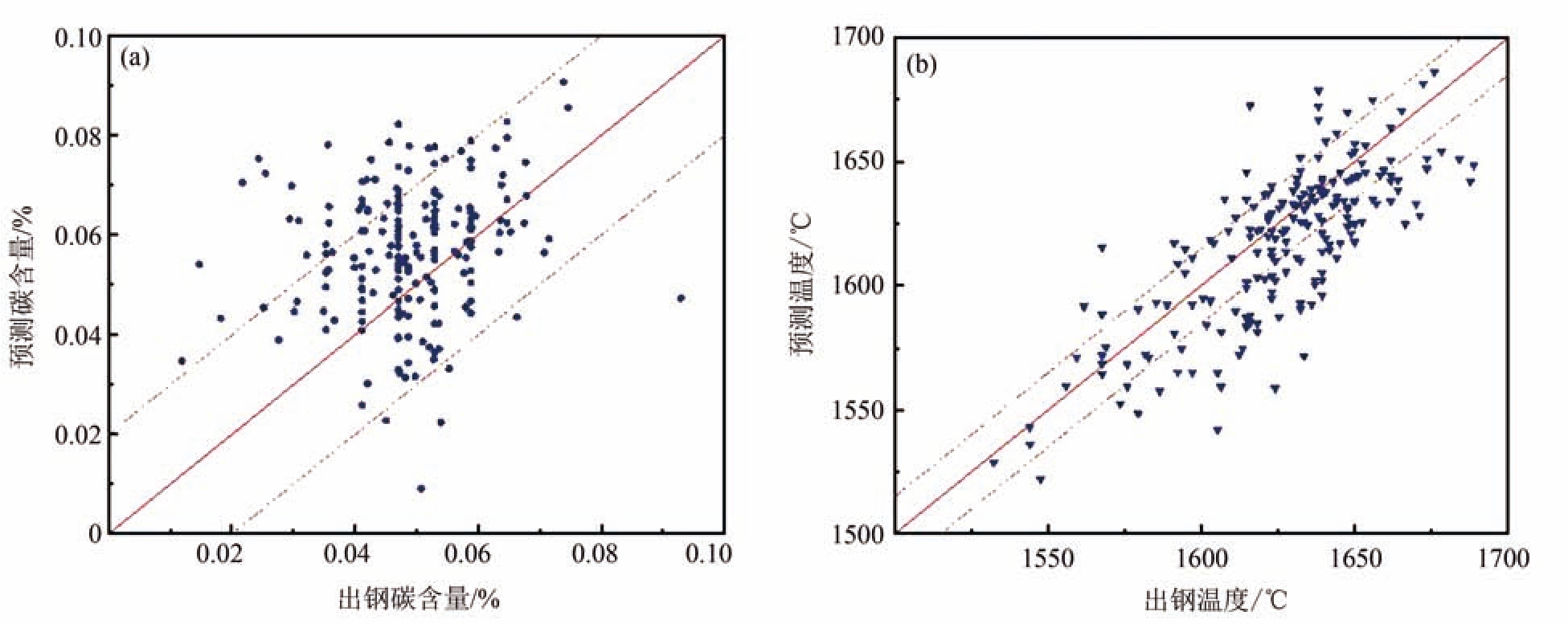

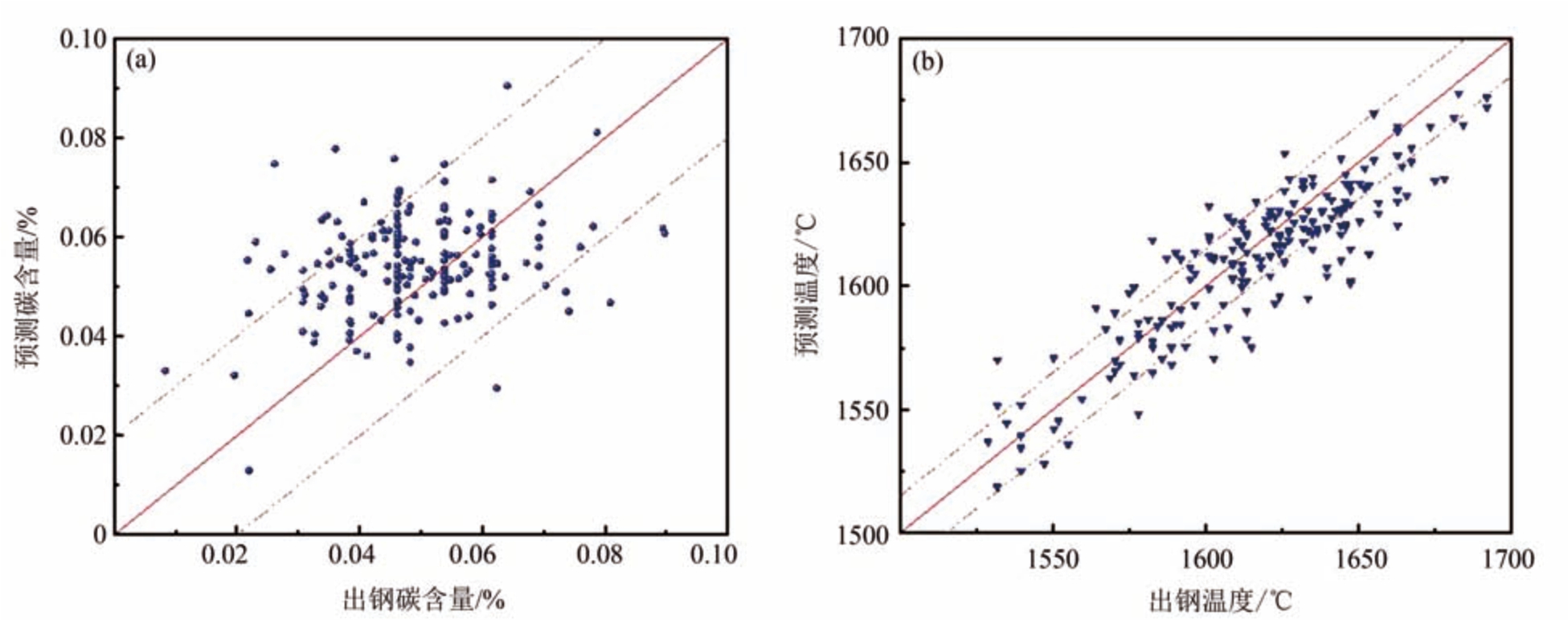

在数据预处理阶段,首先对2 000 组原始数据(每组数据来自1 个炉次)进行标准化处理,并按照8 ∶1 ∶1 的比例划分为训练集、验证集和测试集,其中测试集包含200 组样本用于最终模型评估.基于前期超参数优化结果,采用表1 中对应的4 组最优超参数组合,分别训练4 种不同的预测模型(包括温度模型和碳含量模型),在测试集上进行预测后,可以得到每个模型的预测结果及其对应的RMSE 值,见图2 ~5 及表2.

表2 各模型RMSE 和终点预测命中率

Table 2 RMSE and endpoint prediction hit ratio of each model

温度碳含量算法模型RMSE/℃ 命中率/%RMSE/% 命中率/%CatBoost11.0182.50.01783.0 XGBoost11.7481.00.01878.0 LightGBM16.8265.00.01979.0 AdaBoost12.3479.00.01781.5机理模型17.1459.00.02366.0

图2 AdaBoost 回归算法终点碳温命中率

Fig.2 Carbon temperature hit ratio of endpoint of AdaBoost regression algorithm

图3 XGBoost 回归算法终点碳温命中率

Fig.3 Carbon temperature hit ratio of endpoint of XGBboost regression algorithm

图4 LightGBM 回归算法终点碳温命中率

Fig.4 Carbon temperature hit ratio of endpoint of LightGBM regression algorithm

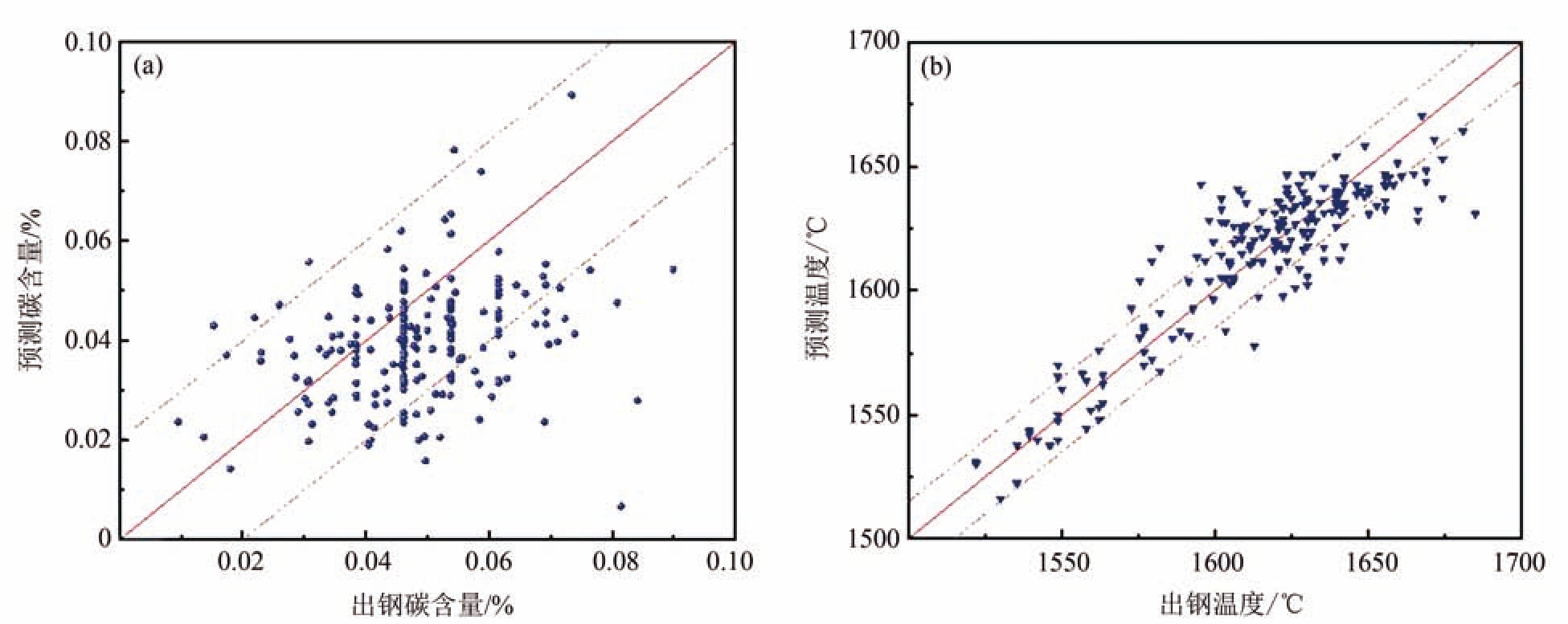

图5 CatBoost 回归算法终点碳温命中率

Fig.5 Carbon temperature hit ratio of endpoint of CatBoost regression algorithm

从表2 中可以看出,当设定出钢碳含量误差允许范围为±0.02%、温度误差允许范围为±15 ℃时,与原有基于冶金机理的模型相比,其余4 种Boosting 算法模型在终点钢水碳含量和温度的命中率上均实现显著提升,且预测结果与目标值的均方根误差明显降低.这一结果表明,Boosting 算法模型能够更精准地逼近转炉终点钢水碳含量和温度的理想目标值,充分验证了其在转炉终点预测任务中的优越性.

此外,还可以发现,在4 种Boosting 算法模型中,CatBoost 模型展现出最优的预测性能:其预测值与实际值的均方误差最小,命中率最高.具体而言,在200 炉次的测试数据中,CatBoost 模型在终点钢水碳含量预测方面,偏差在±0.02%以内的炉次达到166 炉,命中率高达83.0%;在终点温度预测方面,偏差在±15 ℃以内的炉次为165 炉,命中率达82.5%.与原有基于冶金机理的模型相比,CatBoost 模型将终点钢水碳含量命中率显著提升了17.0 个百分点,同时将终点温度命中率大幅提升了23.5 个百分点.

综合分析可知,CatBoost 模型凭借其独特的算法设计展现出显著优势:该模型具备自动填补缺失值的能力,采用的正则化机制可有效抑制过拟合现象,这使得模型在数据噪声较多的复杂场景中仍能保持稳健的预测性能.其采用的对称树结构通过统一各层叶子节点的切分规则,确保了模型决策的稳定性;在残差计算环节,通过随机排列数据并仅利用当前样本之前的信息进行梯度更新,从根本上避免了传统梯度提升算法可能出现的预测偏差问题.

然而,在该钢厂的实际冶炼过程中,特征参数的剧烈波动、数据分布的不均衡性,以及CatBoost模型作为基础算法固有的局限性,仍是制约模型预测精度进一步提升的关键因素.为突破现有瓶颈,后续研究可重点从以下两个方面展开优化:其一,通过构建更精细的特征工程体系,对原始数据进行深度优化与合理划分,同时结合先进的训练算法对CatBoost 模型进行针对性调优;其二,探索CatBoost 模型与其他先进算法的融合路径,通过模型堆叠泛化技术构建集成学习框架,以期获得更具泛化能力的预测模型.

(1)转炉冶炼的影响因素众多,普通机理模型无法实现高精度命中,Boosting 算法模型可以显著提高终点碳温命中率,比基于冶金热力学和动力学冶炼机理建立的控制模型更具有普适性.

(2)CatBoost 模型出钢碳含量误差允许范围为±0.02%,温度误差允许范围±15 ℃内.CatBoost算法的RMSE 值最小,温度RMSE 值为11.01 ℃,碳含量RMSE 值为0.017%;其命中率最高,终点温度命中率为82.5%,终点钢水碳含量命中率为83.0%;与原机理控制模型相比,终点温度命中率提高了23.5 个百分点,终点钢水碳含量命中率提高了17 个百分点.

(3)与AdaBoost,XGBoost 和LightGBM 模型相比,CatBoost 模型不仅在转炉终点碳温预测中精度更高,在数据预处理和调参方面也更为简单,这有效提高了模型训练效率.同时,特有的排序提升方法和正则化技术也使得该模型的计算能力得到提高,并且对数据中的噪声和离群值有更好的鲁棒性.总的来说,CatBoost 模型能够更好地处理实际冶炼中的复杂数据情况,更适合用来预测转炉冶炼终点的碳温,可为实际生产提供指导.

[1] 鲁川.转炉炼钢终点控制技术探讨[J].冶金与材料,2021(2):87-88.(Lu Chuan.Discussion on endpoint control technology of converter steelmaking[J].Metallurgy and Materials,2021(2):87-88.)

[2] 郭宝辉.用于转炉终点预测的光谱采集系统设计[D].南京:南京理工大学,2014.(Guo Baohui.Design of spectrum acquisition system for predicting the end point of converter [D].Nanjing:Nanjing University of Science and Technology,2014.)

[3] 潘玉柱,张彩军,朱新华,等.基于烟气分析的转炉连续碳温预报模型[J].河南冶金,2014,22(5):15-17.(Pan Yuzhu,Zhang Caijun,Zhu Xinhua,et al.Converter continuous carbon temperature prediction model based on flue gas analysis[J].Henan Metallurgy,2014,22(5):15-17.)

[4] Mitchell T M.Machine Learning[M].New York:McGraw-Hill,1997.

[5] Zhou Z H.Ensemble Methods:Foundations and Algorithms[M].Boca Raton:CRC Press/Taylor &Francis,2012.

[6] 高尉.Boosting 方法的理论研究[D].南京:南京大学,2014.(Gao Wei.Theoretical recsearch on boosting[D].Nanjing:Nanjing University,2014.)

[7] Freund Y,Schapire R E.A decision-theoretic generalization of on-line learning and an application to boosting[J].Journal of Computer and System Sciences,1997,55(1):119-139.

[8] Freund Y,Schapire R E.Game throry,on-line prediction and boosting[C] / / Proceedings of the 9th Annual Conference on Learning Theory.New York: Association for Computing Machinery,1996:325-332.

[9] Freund Y,Schapire R E.A decision-theoretic generalization of on-line learning and an application to boosting[J].Journal of Computer and System Sciences,1997,55(1):119-139.

[10] Friedman J,Tibshirani R,Hastie T.Additive logistic regression:a statistical view of boosting (With discussion and a rejoinder by the authors)[J].The Annals of Statistics,2000,28(2):337-407.

[11] Chen T Q,Guestrin C.XGBoost: a scalable tree boosting system [ C]/ /Proceedings of the 22nd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining.San Francisco,California,USA.ACM,2016:785-794.

[12] 徐猛,雷洪,何江一,等.利用改进XGBoost 预测RH 精炼终点钢水温度[J].材料与冶金学报,2023,22(5):437-443.(Xu Meng,Lei Hong,He Jiangyi,et al.Predicting the endpoint steel temperature ofRH refining using improved XGBoost[J].Journal of Materials and Metallurgy,2023,22(5):437-443.)

[13] 查伟,董艳伍,姜周华,等.基于GBDT 算法真空自耗铸锭终点锰含量预测模型[J].中国冶金,2023,33(7):107-114.(Zha Wei,Dong Yanwu,Jiang Zhouhua,et al.Prediction model of end-point manganese content in vacuum consumable ingot based on GBDT algorithm[J].China Metallurgy,2023,33(7):107-114.)

[14] 刘福龙,郝良元,靳亚涛,等.基于CatBoost 算法的高炉铁水硫含量预测[J].河北冶金,2023(6):31-36.(Liu Fulong,Hao Liangyuan,Jin Yatao,et al.Prediction of sulfur content of molten iron in blast furnace based on catboost algorithm[J].Hebei Metallurgy,2023(6):31-36.)

[15] Dhananjay B,Sivaraman J.Analysis and classification of heart rate using CatBoost feature ranking model[J].Biomedical Signal Processing and Control,2021,68:102610.

[16] 蔡明,孙杰,李培德,等.三种机器学习算法在回归应用中的对比分析[J].智能计算机与应用,2022,12(8):165-170.(Cai Ming,Sun Jie,Li Peide,et al.Comparative analysis of three machine learning algorithms in regression application[J].Intelligent Computer and Applications,2022,12 ( 8 ):165-170.)

[17] 廖红文,周德龙.AdaBoost 及其改进算法综述[J].计算机系统应用,2012,21(5):240-244.(Liao Hongwen,Zhou Delong.Review of AdaBoost and its improvement[J].Computer Systems &Applications,2012,21(5):240-244.)

[18] 李玉琦.复杂预测模型超参数优化研究[D].北京:北京邮电大学,2022.(Li Yuqi.Research on hyperparametric optimization in complex prediction model[D].Beijing:Beijing University of Posts and Telecommunications,2022.)

[19] Bergstra J,Bengio Y.Random search for hyper-parameter optimization[J].Journal of Machine Learning Research,2012,13:281-305.

[20] Hutter F,Kotthoff L,Vanschoren J.Automated Machine Learning:Methods,Systems,Challenges[M].Cham:Springer International Publishing,2019.

[21] Parker-Holder J,Rajan R,Song X Y,et al.Automated reinforcement learning ( AutoRL): a survey and open problems[J].Journal of Artificial Intelligence Research,2022,74:517-568.

Endpoint prediction model of converter based on Boosting algorithm

X