DOI:10.14186/j.cnki.1671-6620.2026.01.005

中图分类号:TF

吴国超1, 李爱莲1, 解韶峰2

| 【作者机构】 | 1内蒙古科技大学自动化与电气工程学院; 2内蒙古科技大学后勤与基本建设处 |

| 【分 类 号】 | TF |

| 【基 金】 | 内蒙古自治区自然科学基金项目(2022MS06003) 国家自然科学基金资助项目(61763039). |

转炉炼钢技术因高效率和低成本的优点,成为目前全球应用最广泛的炼钢技术.转炉炼钢是一个多元多相的过程,并且涉及许多复杂的高温物理化学反应,也是比较典型的“黑箱”过程,难以通过数学方程对其实现准确描述[1].同时,转炉炼钢的终点控制技术是转炉冶炼后期操作中最为关键的技术,转炉炼钢终点控制核心是终点温度[2],而精准的终点温度预测是终点控制的前提.因此,建立一个精准的转炉炼钢终点温度预测模型,不仅可以提高操作人员对出钢判断的准确性,而且对进一步提高转炉冶炼终点命中率,提高生产效率和钢水质量,降低生产成本意义重大[3].经查阅文献,转炉炼钢终点温度预测模型大多采用传统模型,例如李星彤等[4]采用4种集成提升(Boosting)模型对转炉炼钢终点温度进行预测对比,其中类别特征提升(CatBoost)模型在±15℃的温度预测偏差内,命中率为82.5%;张聪聪等[5]利用BP神经网络、极限学习机(ELM)和支持向量机(SVM),分别建立了转炉炼钢终点温度预测模型,在“全三脱”工艺下,SVM模型具有更高的预测精度,在±15℃的温度预测偏差内,命中率为90.6%.由于传统模型在预测性能方面存在局限性,近年来,轻梯度提升机(light gradient boosting machine,LightGBM)模型因具有高效、准确的特性而被广泛应用于各种数据科学和机器学习任务[6].杨仕存等[7]采用贝叶斯算法(BOA)优化BP神经网络、SVM和LightGBM模型的参数,并对应建立了转炉耗氧量模型,结果表明,BOALightGBM模型有着更高的预测精度和稳定性,以及更强的泛化能力,适用于处理转炉系统复杂的非线性数据.张莉等[8]提出将改进白鲸优化算法(MYBWO)应用于LightGBM模型,结果表明,与LightGBM、BP神经网络、SVM等基本模型以及其他优化模型相比,MYBWO-LightGBM模型的预测精度更高,稳定性更好.

上述研究成果均为本文提供了重要的理论支撑.尽管LightGBM模型在机器学习的预测建模领域被广泛应用且有较好的预测效果,但该模型在转炉炼钢领域的应用研究较少.本文中基于LightGBM构建了转炉炼钢终点温度预测模型,并采用极端梯度提升(XGBoost)、SVM模型进行对比,验证LightGBM模型在处理转炉数据时的优势.此外,采用改进的黑翅鸢优化算法(IBKA)对LightGBM模型进行参数优化,同时采用其他5种智能算法(胜利算法JAYA、灰狼优化算法GWO、鲸鱼优化算法WOA、红嘴蓝鹊算法RBMO、黑翅鸢优化算法BKA)分别优化LightGBM模型,形成不同的融合策略进行对比.在多种性能指标评价下,验证IBKALightGBM模型的优越性,为转炉炼钢终点温度的精准预测提供有益参考.

转炉炼钢是一个滞后性强、非线性化程度高、噪声干扰频繁的过程,现场采集到的数据,一般是所需数据的真实值和各种噪声叠加起来的结果,具有多变量、多噪声、多样本的特点.针对转炉炼钢生产的工艺特点和相关变量之间的相互影响关系,需要对收集到的数据进行预处理.

(1)本文中所用的实验数据源于某钢厂的实际生产数据.在生产现场,利用传感器获取铁水总量、良坯量、耗氮量、氧气消耗量、铁皮球数量等30多个维度的数据特征,并从中选取SPCC钢种的数据.为保证模型在实际生产中预测的准确性,结合相关理论及灰色关联度法,分析影响转炉炼钢温度的主要变量.最终确定模型的输入变量为铁水总量、原料总量、大包进站量、钢水量、良坯量、钢铁料消耗量、氧气消耗量、铁水中的Mn含量(即脱硫后Mn的质量分数)、铁水中的P含量(即脱硫后P的质量分数)、铁水温度(共计10个特征变量),输出变量为终点温度.

(2)鉴于生产数据中缺失的数据量较少,剔除特征变量中存在缺失值的炉次.

(3)为保证模型具有足够的训练样本量,采用均值填补法对变量的异常零值进行处理.

(4)数据可能存在错记、遗漏等问题,导致出现偏离实际情况的异常值.采用3σ原则对异常值进行剔除,最终选取300炉次的数据作为实验数据.

LightGBM是微软于2017年提出的一个基于决策树算法的分布式梯度提升框架,是类似于XGBoost的机器学习算法,主要用于解决传统梯度提升决策树GBDT在应对工业级大规模数据集时,为寻找最优分割点遍历所有数据导致的内存大、计算效率低、预测精度不足等问题[9].LightGBM在GBDT的基础上实现的主要优化如下:利用GOSS算法,保留大梯度样本,随机抽取小梯度样本,并保持数据原来的分布,在减少数据量和保证精度上达到平衡;利用EFB算法,将互斥特征合并为更稠密的特征,即把多个特征捆绑,变成一个特征,减少特征维度的数量,提高建直方图的效率,进而提升训练速度;在决策树学习中,利用直方图算法,先对特征值进行装箱处理(即把连续的浮点特征值划分到某一段离散的数值区间bin中),将特征值从连续值转化成离散值,并以bin为单位构造直方图,进而缩减计算量和内存消耗;决策树生长策略采用比按层生长(level-wise)更佳的按叶生长(leafwise),从而避免冗余的搜索和分割.为验证LightGBM模型的高效性、准确性和鲁棒性,选择XGBoost、SVM作为对比模型.

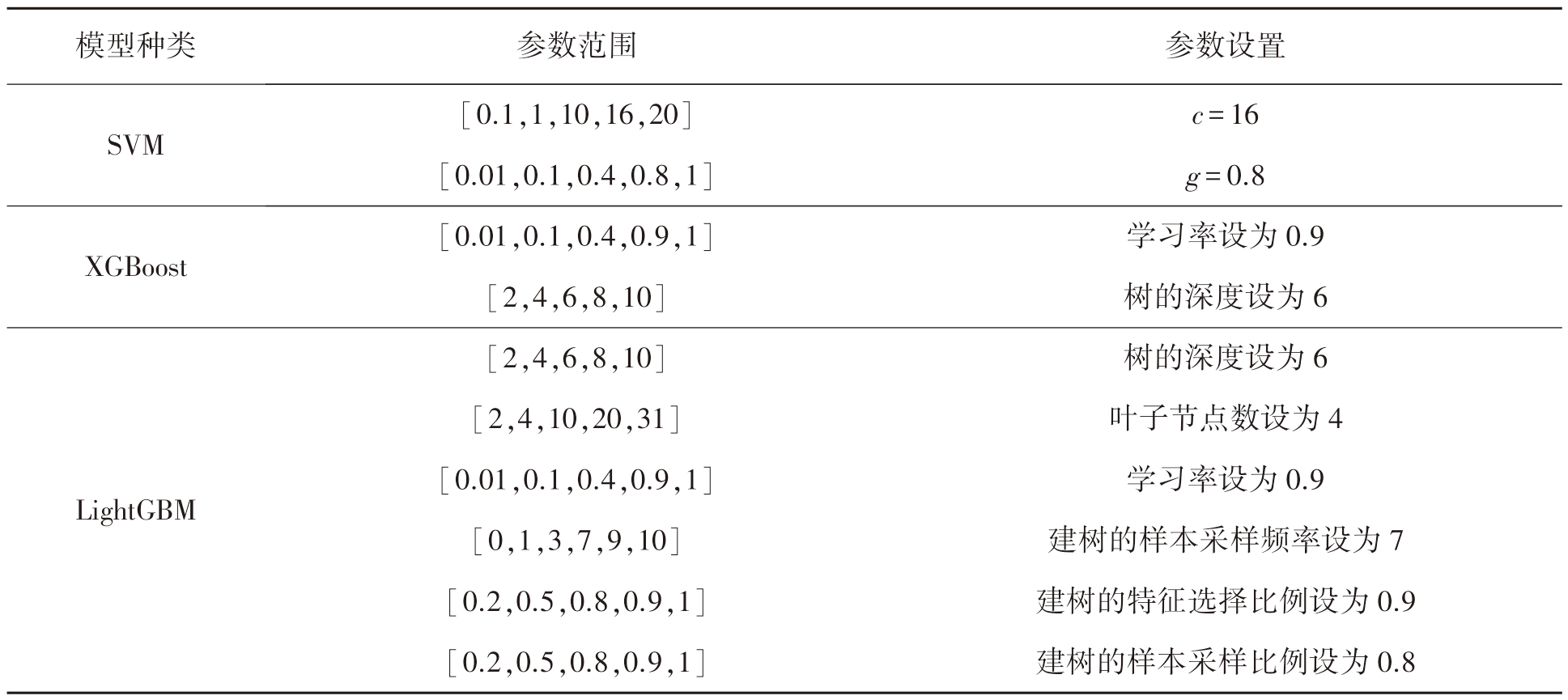

以1.1节列出的10个特征变量作为输入变量,以数据处理后最终选取的300个炉次的数据作为实验数据,以210个炉次的数据作为训练集,以90个炉次的数据作为测试集,分别建立基于SVM、XGBoost、LightGBM的转炉炼钢终点温度预测模型.模型的关键参数对其性能有重要影响:SVM的惩罚因子c和核函数参数g共同调控模型复杂度与过拟合风险;XGBoost和LightGBM是基于决策树的梯度提升集成模型,学习率控制了每棵树的权重更新幅度,树的深度以及叶子节点数共同决定了模型的复杂度,选择合适的建树采样策略参数可以提高模型的训练速度和泛化性.本文中采用网格搜索方法对3种模型的参数进行设置,具体如表1所列.3种模型经过参数设置后的最终预测结果如图1~3所示.

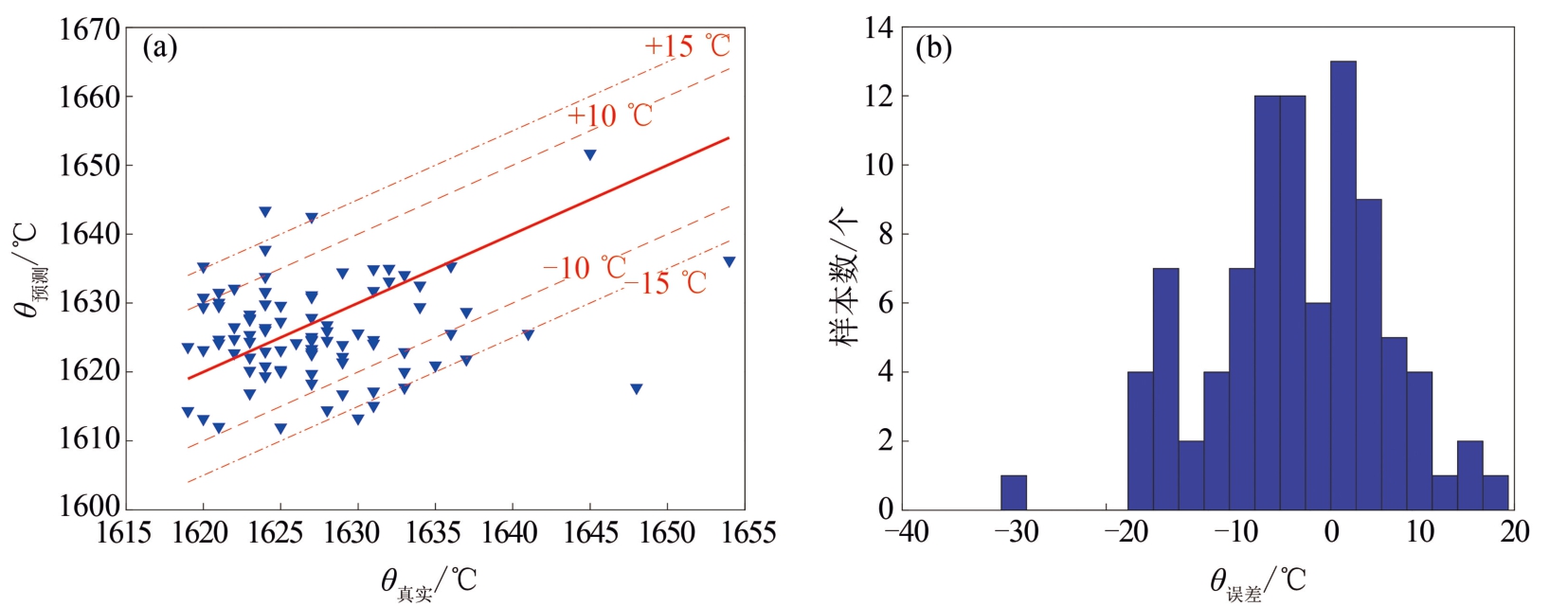

图1 SVM模型预测结果

Fig.1 SVM model prediction results

(a)—散点图;(b)—误差图.

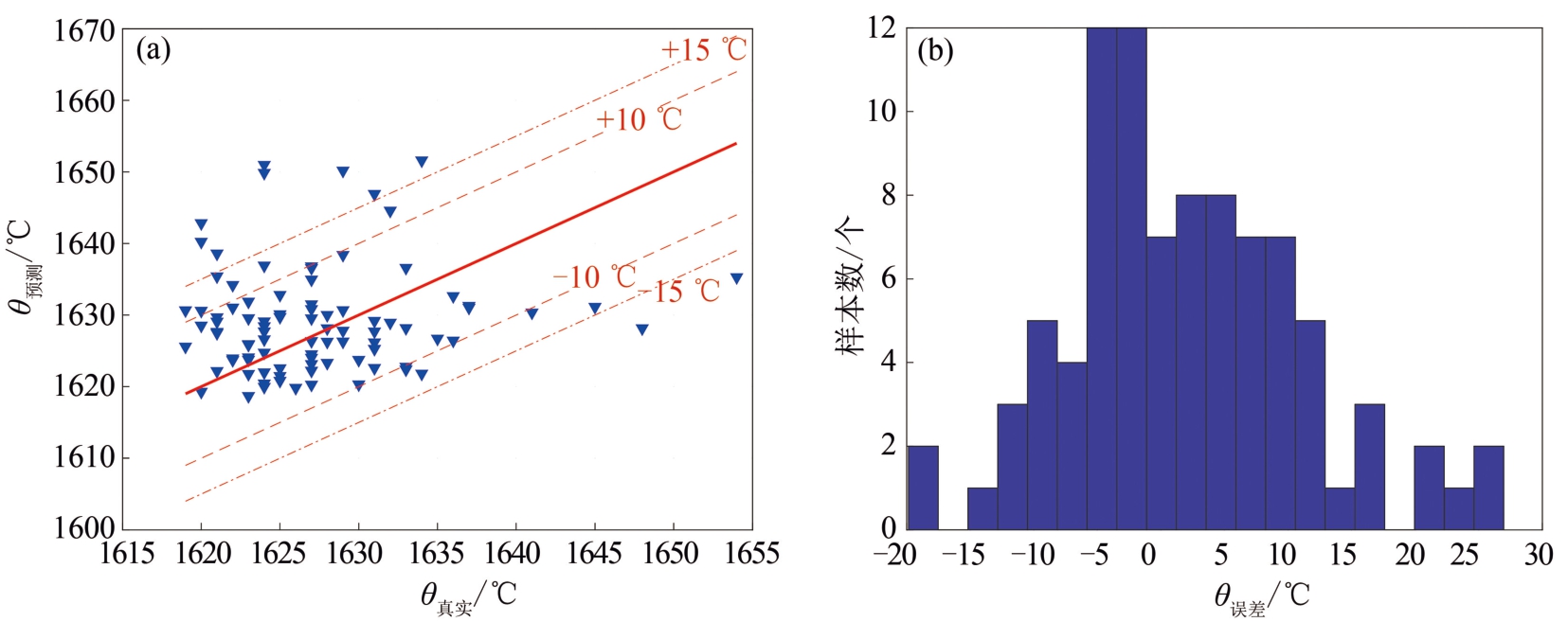

图2 XGBoost模型预测结果

Fig.2 XGBoost model prediction results

(a)—散点图;(b)—误差图.

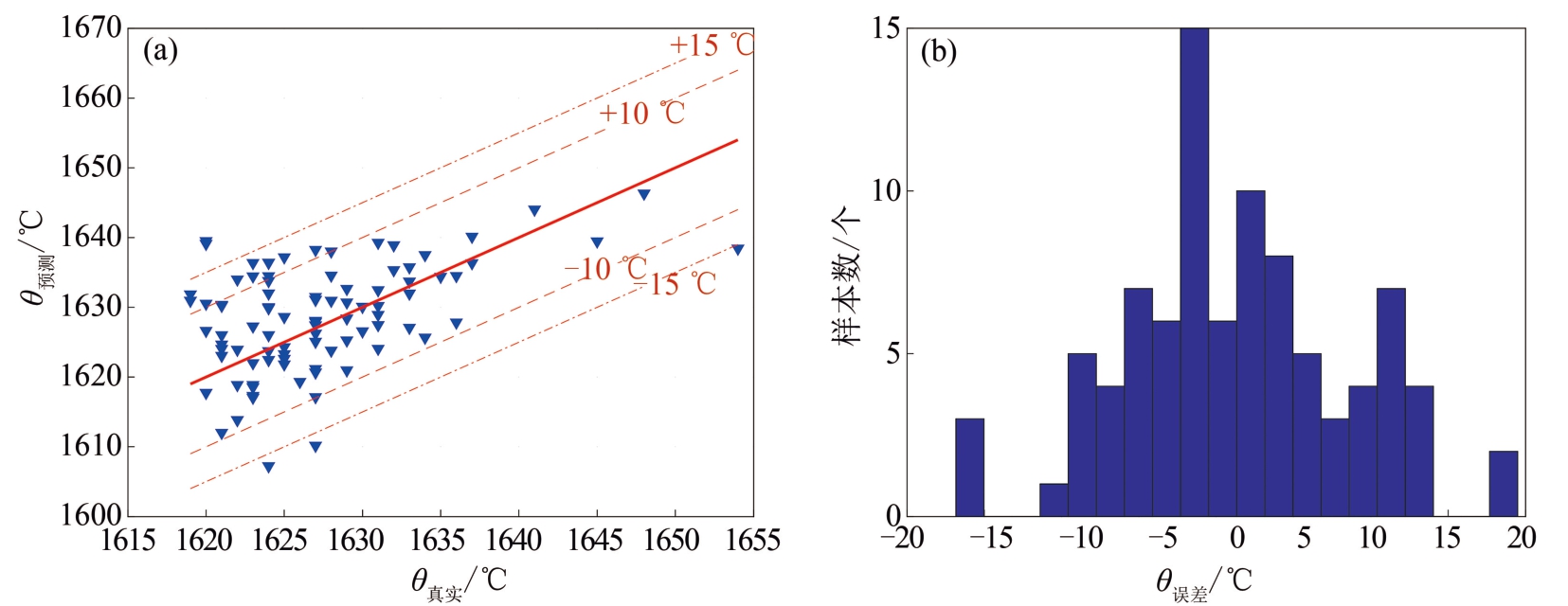

图3 LightGBM模型预测结果

Fig.3 LightGBM model prediction results

(a)—散点图;(b)—误差图.

表1 3种模型的参数

Table 1 Parameters of three models

模型种类参数范围参数设置SVM[0.1,1,10,16,20] c=16[0.01,0.1,0.4,0.8,1] g=0.8 XGBoost[0.01,0.1,0.4,0.9,1] 学习率设为0.9[2,4,6,8,10] 树的深度设为6 LightGBM[2,4,6,8,10] 树的深度设为6[2,4,10,20,31] 叶子节点数设为4[0.01,0.1,0.4,0.9,1] 学习率设为0.9[0,1,3,7,9,10] 建树的样本采样频率设为7[0.2,0.5,0.8,0.9,1] 建树的特征选择比例设为0.9[0.2,0.5,0.8,0.9,1] 建树的样本采样比例设为0.8

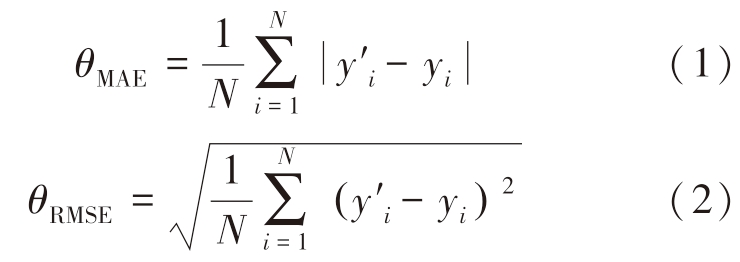

对比3种模型的预测结果,发现LightGBM模型的预测结果更加集中且与真实值偏差更小.为了更全面地评估3种模型的性能,引入平均绝对误差(θMAE)、均方根误差(θRMSE)、预测值与实际值的误差在±10℃和±15℃下的命中率(P h)作为评价指标,结果如表2所列.

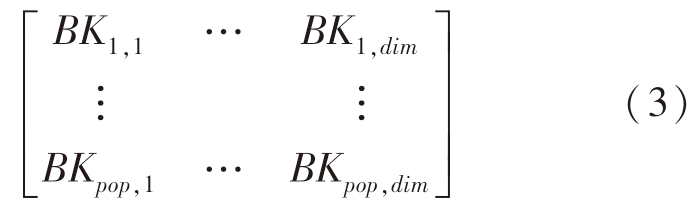

表2 3种模型的性能评价指标

Table 2 Performance evaluation indices for three models

模型种类θMAE/℃θRMSE/℃P h/%±10℃±15℃SVM 6.813 7 8.672 2 75.56 88.89 XGBoost 7.272 9 9.397 1 76.67 88.89 LightGBM 5.774 7 7.395 5 81.11 94.44

式中:N为样本数,y′i为样本预测值,yi为样本真实值.

从表2中可知,与SVM和XGBoost模型相比,LightGBM模型的平均绝对误差值和均方根误差值均更小,且在±10℃和±15℃的误差范围内命中率更高,分别达到81.11%和94.44%,预测效果更优.LightGBM模型凭借其在GBDT基础上的多种策略优化,能够处理XGBoost、SVM模型在高维冶炼数据下的计算冗余问题和对数据特点捕捉、关键样本优先与全局训练的平衡难题.而且LightGBM模型的可调参数更多、设置更灵活,对于数据集的处理速度更快、更精准,能够尽可能地模拟转炉“黑箱”过程.

上述评价结果验证了LightGBM模型可以充分发挥在处理较大规模数据集时快速训练并得到准确结果的优势,进而实现对转炉炼钢终点温度的精准预测.

Wang等[10]受黑翅鸢狩猎技巧和迁移习惯的启发,提出了黑翅鸢优化算法(black-winged kite algorithm,BKA).该算法不仅捕捉了黑翅鸢在自然界中的飞行和捕食行为,而且深度模拟了黑翅鸢对环境变化和目标位置的高度适应性.同时,BKA集成了一种柯西变异策略和领导策略,增强了算法的全局搜索能力并加快了收敛速度,有效提升了各种优化问题的解决能力.

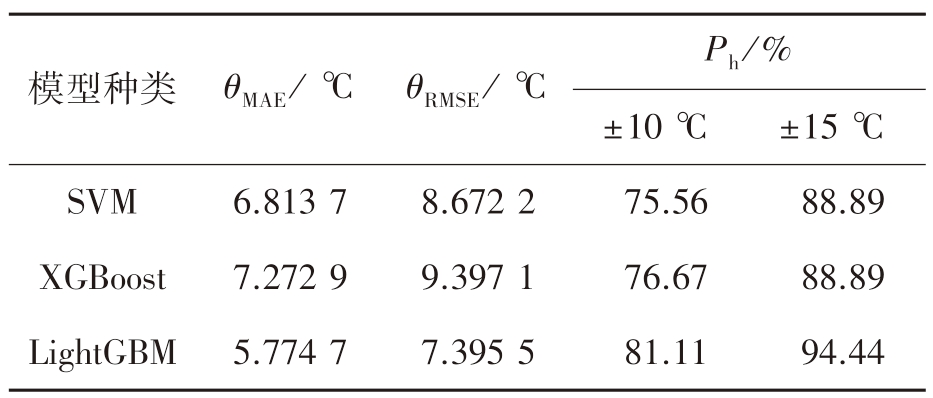

(1)种群初始化.以下矩阵用来表示每只黑翅鸢的位置:

式中,pop表示潜在的解决方案数量即种群数量,dim表示给定问题的维度数量,BK i,j表示第i个黑翅鸢在第j维的位置上.利用式(4)均匀地分配每只黑翅鸢的位置:

式中,i为[1~pop] 之间的整数,BK lb和BK ub分别为黑翅鸢位置的下界和上界,r为[0,1] 之间的随机数.

在初始化过程中,BKA选择适应度值最好的个体作为初始群体中的领导者,这被认为是黑翅鸢的最优位置.式(5)为初始领导者X L的数学式,以最小值为例.

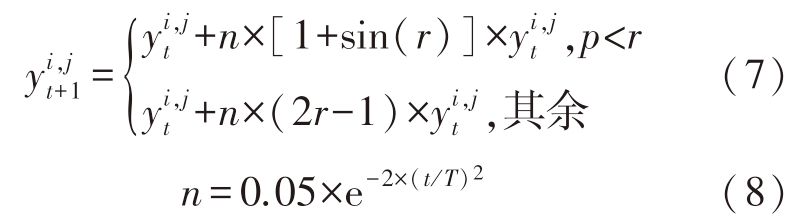

(2)攻击行为.黑翅鸢攻击行为包括空中悬停和冲向猎物,用于全局探索和搜索.黑翅鸢攻击行为的数学模型如式(7)和(8)所示,当满足p<r时,黑翅鸢便会采取攻击行为,冲向猎物.

式中: 和

和 分别为黑翅鸢在第t和(t+1)次迭代时的位置;p为常数,取值0.9;T为迭代的总次数;t是为目前为止已经完成的迭代次数.

分别为黑翅鸢在第t和(t+1)次迭代时的位置;p为常数,取值0.9;T为迭代的总次数;t是为目前为止已经完成的迭代次数.

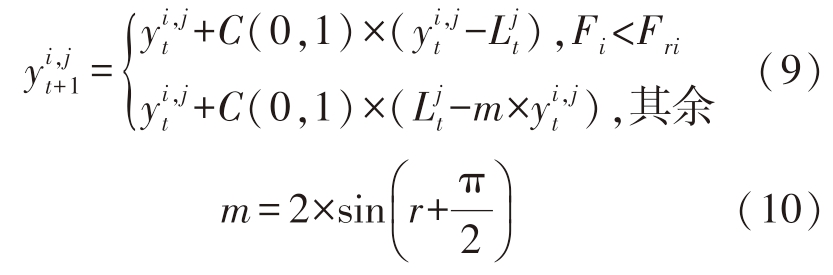

(3)迁徙行为.黑翅鸢迁徙策略是动态地选择优秀的领导者,以确保迁徙成功.黑翅鸢迁徙行为的数学模型如式(9)和(10)所示.

式中: 表示到目前为止,在第t次迭代时,当前黑翅鸢的领导者;F i表示第t次迭代中黑翅鸢在其位置的适应度值;F ri表示第t次迭代中任意黑翅鸢在其位置的适应度值;C(0,1)表示柯西变异,一维柯西分布是具有2个参数的连续概率分布.一维柯西分布的概率密度函数为

表示到目前为止,在第t次迭代时,当前黑翅鸢的领导者;F i表示第t次迭代中黑翅鸢在其位置的适应度值;F ri表示第t次迭代中任意黑翅鸢在其位置的适应度值;C(0,1)表示柯西变异,一维柯西分布是具有2个参数的连续概率分布.一维柯西分布的概率密度函数为

当δ=1、μ=0时,一维柯西分布的概率密度函数可化为标准形式,如下所示:

黑翅鸢优化算法具有搜查能力好、收敛精度高、鲁棒性强等特点,但随着迭代次数的增加,易陷入局部最优的困境[11].因此,本文中对黑翅鸢优化算法进行以下改进.

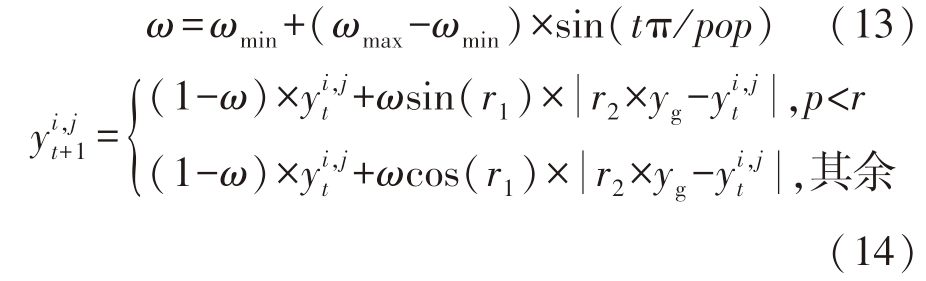

(1)融入正弦余弦算法.在BKA中,随着迭代次数的进行,黑翅鸢采取攻击行为后,其个体的每一维都会变小,同时搜索空间逐渐缩小,落入局部空间的概率增大.为了解决此问题,在黑翅鸢的攻击行为中融入正弦余弦算法(SCA),并引入非线性正弦学习因子ω.ω在进行攻击行为前期具有较大的值,有利于全局探索,在攻击行为后期具有较小的值,有利于提升模型局部开拓能力并提高其精确度[12].

学习因子公式和改进后的黑翅鸢攻击行为公式如下所示:

式中:ωmax为常数,取值为1;ωmin为[0,1] 之间的随机数;r1为[0,2π] 之间的随机数;r2为[0,2] 之间的随机数;y g为黑翅鸢领导者的位置.

(2)采用柯西-高斯变异策略.在黑翅鸢优化算法不断迭代的后期,由于个体之间的迅速同化,算法的多样性逐渐下降,容易出现局部最优停滞的情况.针对该问题,采用柯西-高斯变异策略,选择当前适应度最好的个体进行变异,然后比较其变异前后的位置,选择较优的位置代入下一次迭代[13].具体公式如下:

式中: 为最优个体变异后的位置;Cauchy(r)为服从柯西分布的随机数;Gauss(r)为服从高斯分布的随机数;λ1=

为最优个体变异后的位置;Cauchy(r)为服从柯西分布的随机数;Gauss(r)为服从高斯分布的随机数;λ1=![]() 二者均为随迭代次数自适应调整的动态参数.

二者均为随迭代次数自适应调整的动态参数.

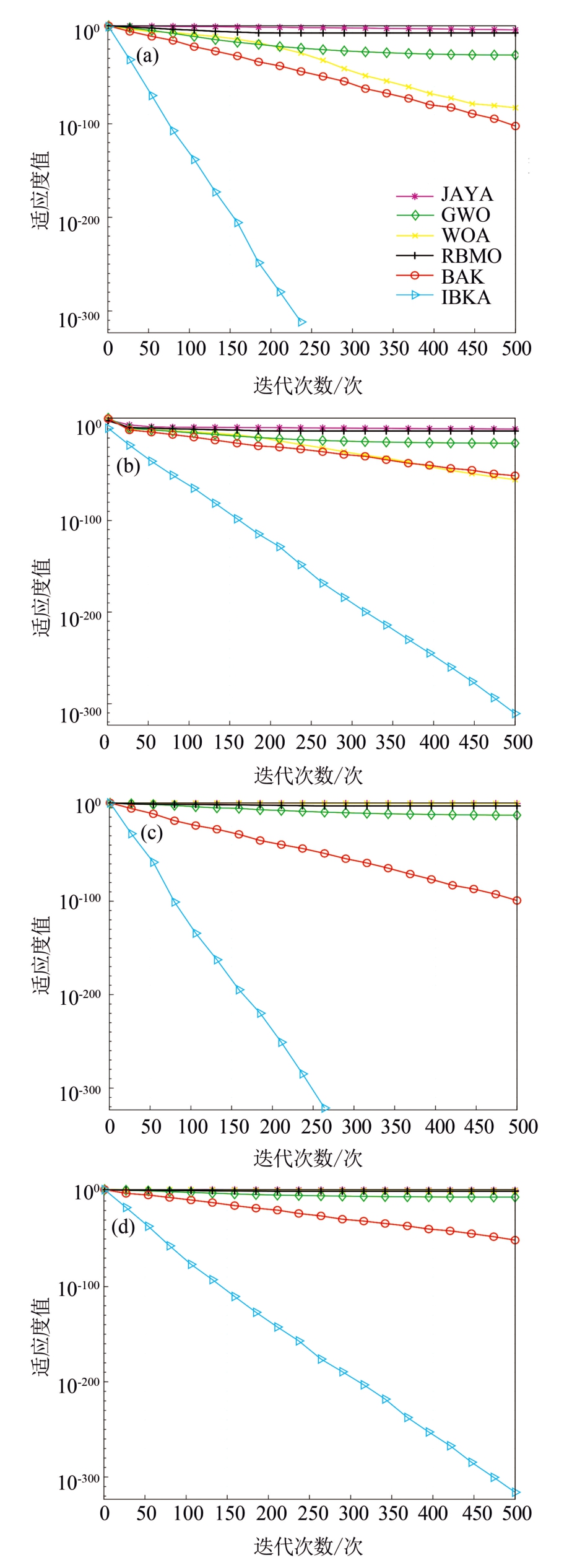

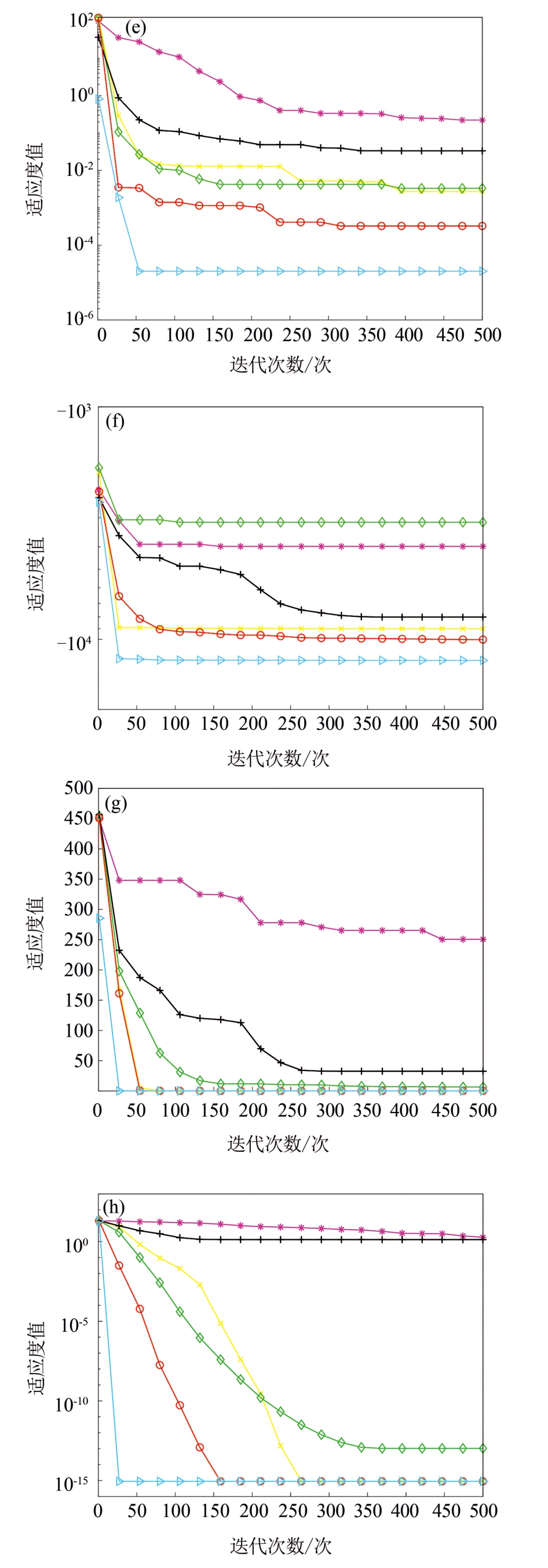

为了检验改进的黑翅鸢优化算法(IBKA)的优越性,使用CEC2005测试函数集中的8个测试函数对IBKA与JAYA、GWO、WOA、RBMO[14]、BKA进行仿真对比.为保证对比的公平性和客观性,将8种测试函数(F1~F4为单峰,F7~F10为多峰)设置相同的参数,即种群数量均为30个,迭代次数均为500次,空间维度数量均为30维.测试结果如图4所示.

图4 测试函数的收敛曲线

Fig.4 Test function convergence curve

(a)—F1;(b)—F2;(c)—F3;(d)—F4;(e)—F7;(f)—F8;(g)—F9;(h)—F10.

分析图4,发现随着迭代次数的增加,IBKA均能准确、快速地寻找到全局最优解;IBKA的收敛速度更快,并且收敛精度也更高,而其他5种智能算法的收敛速度较慢,易出现局部最优停滞的情况.综合来看,与BKA相比,IBKA的收敛性能有较大的提高,并且为模型的优化提供了算法基础.

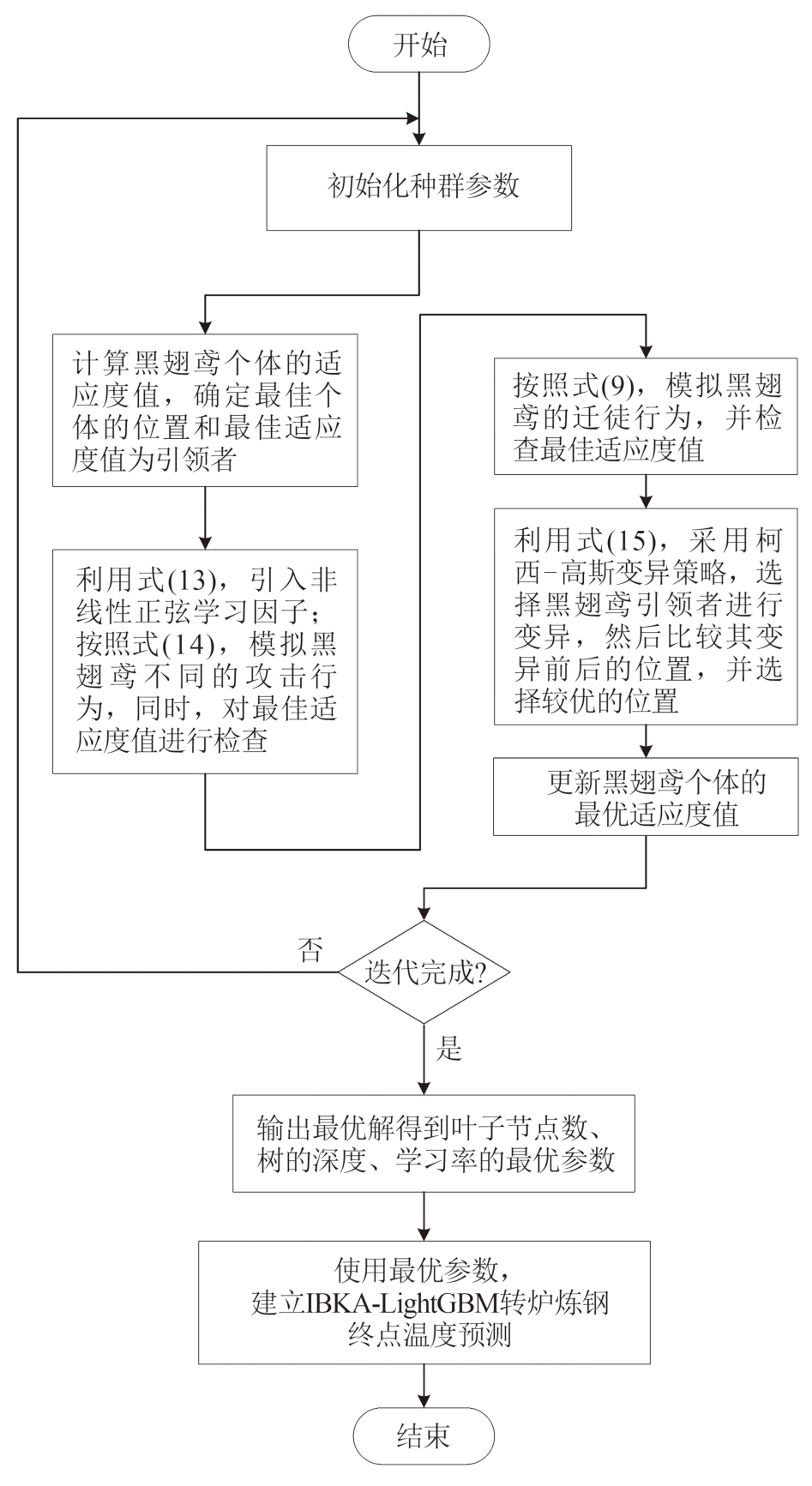

在LightGBM模型中,叶子节点数、树的深度和学习率是最为核心的超参数,三者共同调控模型的复杂度、泛化能力及收敛速度.采用IBKA对LightGBM模型的上述3个超参数进行寻优,以提高该模型的预测精度和泛化性.优化流程如图5所示.

图5 IBKA优化LightGBM模型流程

Fig.5 IBKA optim izes LightGBM m odel process

利用上文中与IBKA对比的5种智能算法(JAYA、GWO、WOA、RBMO、BKA)分别对LightGBM模型进行优化,从而与本文中建立的IBKA-LightGBM模型进行性能优劣对比及分析.为保证对比的公平性和客观性,将JAYA-LightGBM、GWO-LightGBM、WOA-LightGBM、RBMO-LightGBM、BKA-LightGBM和IBKA-LightGBM总共6种模型的非优化参数和智能算法参数设置为相同条件.

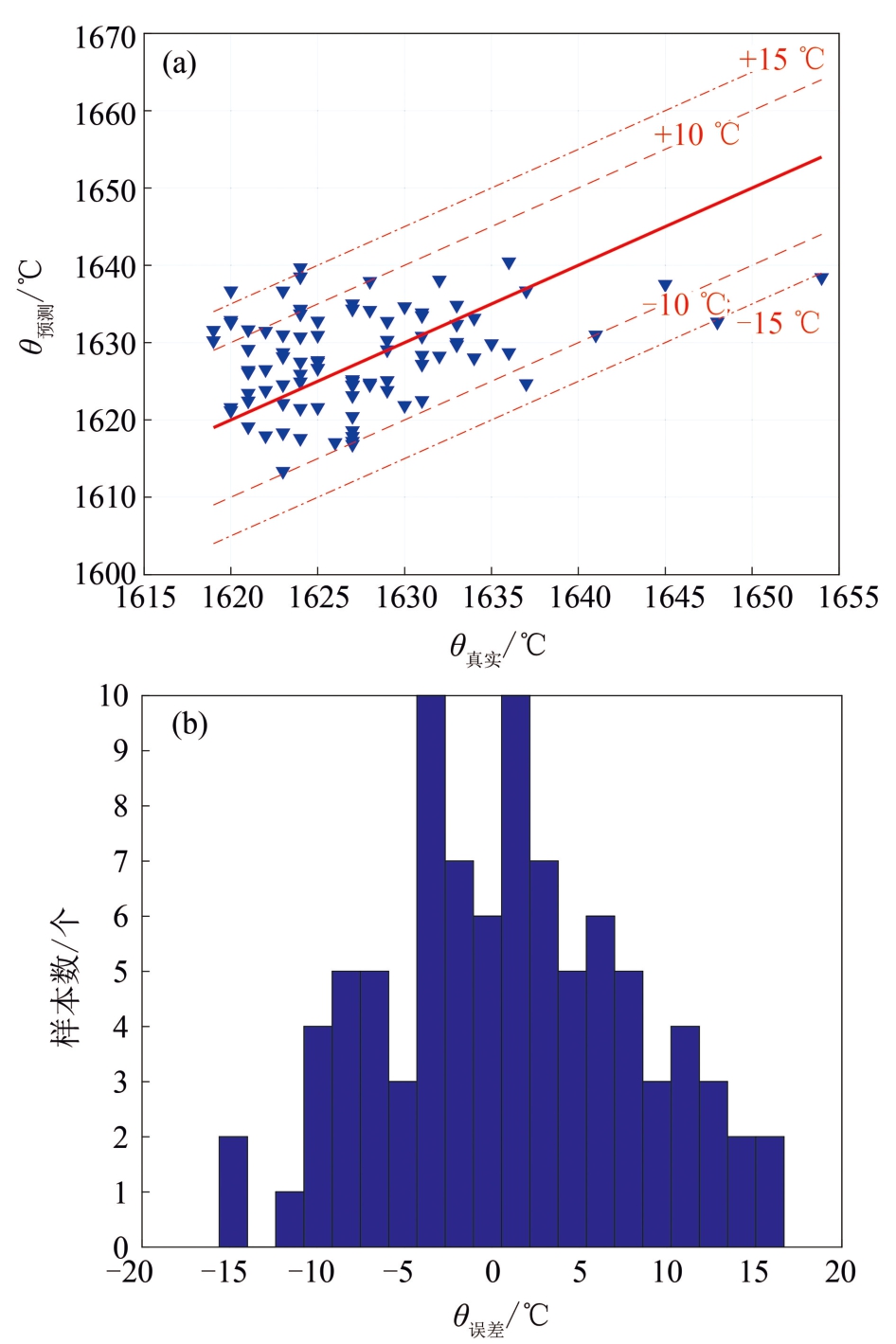

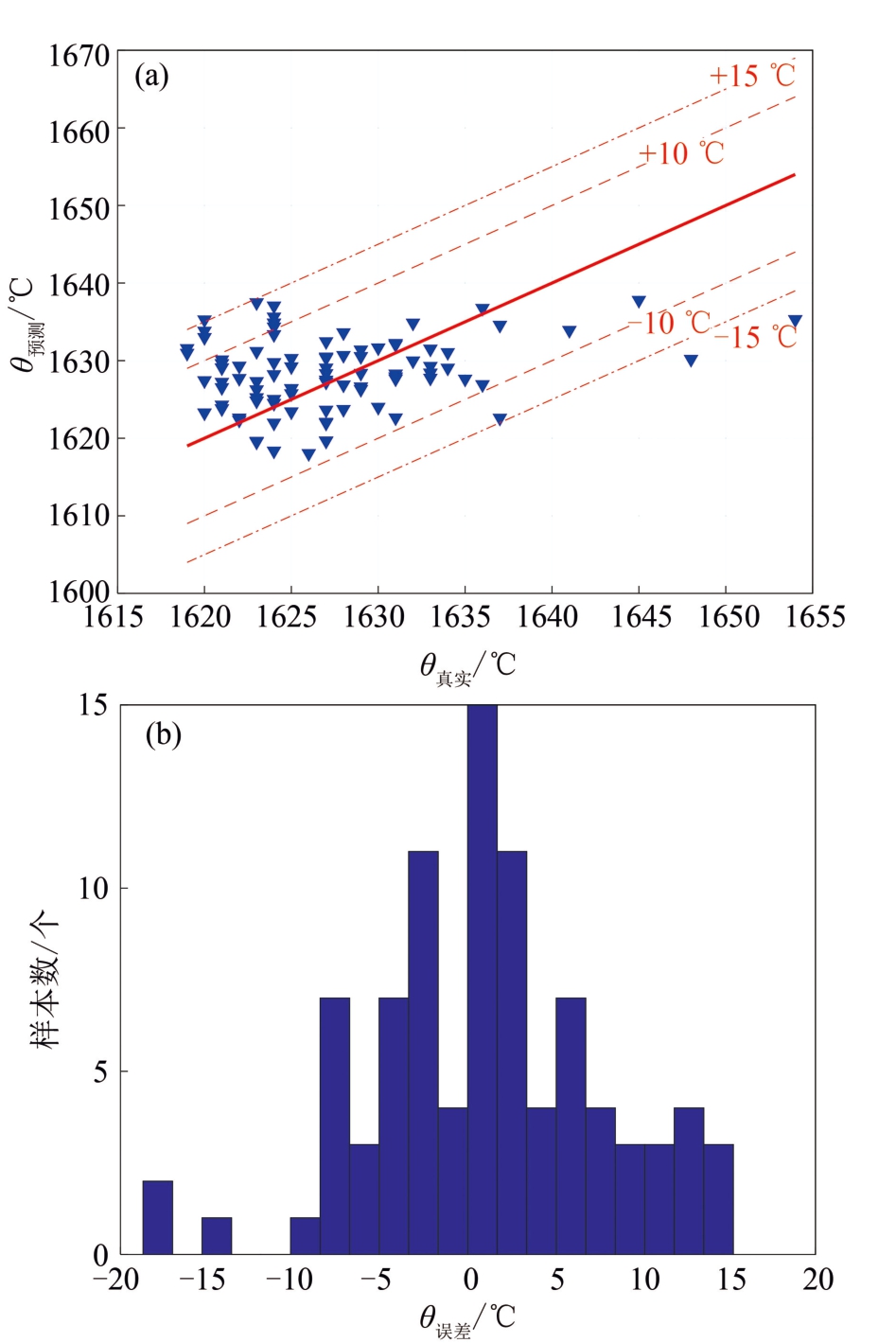

LightGBM模型经BKA和IBKA优化后,终点温度的实际值与对应优化模型的预测值如图6和图7所示.对比图6和图7可知,IBKA-LightGBM模型的预测结果更为集中且与真实值的偏差更小.

图6 BKA-LightGBM模型预测结果

Fig.6 BKA-LightGBM model prediction results

(a)—散点图;(b)—误差图.

图7 IBKA-LightGBM模型预测结果

Fig.7 IBKA-LightGBM model prediction results

(a)—散点图;(b)—误差图.

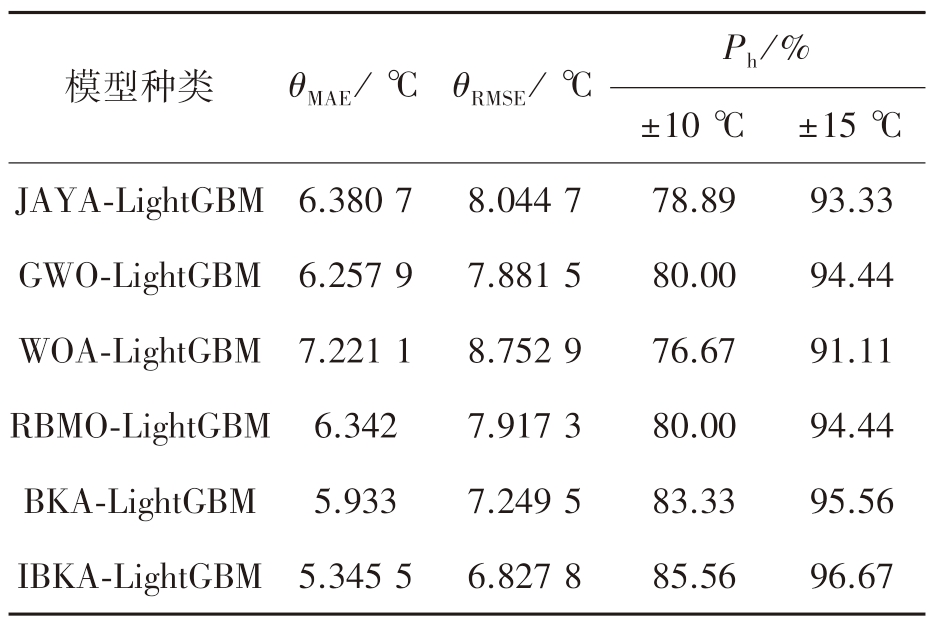

由图6、图7及表3可知,与其他5种智能算法相比,IBKA优化后的LightGBM转炉炼钢终点温度预测模型具有最佳预测效果,其平均绝对误差、均方根误差均最小,且在±10℃和±15℃下的命中率最高.这不仅证明了IBKA-LightGBM模型具有更高的预测精度,也为转炉终点预测建模提供一定的理论基础.

表3 6种优化模型的性能评价指标

Table 3 Performance evaluation indices for six optimization models

模型种类θMAE/℃θRMSE/℃P h/%±10℃±15℃JAYA-LightGBM 6.380 7 8.044 7 78.89 93.33 GWO-LightGBM 6.257 9 7.881 5 80.00 94.44 WOA-LightGBM 7.221 1 8.752 9 76.67 91.11 RBMO-LightGBM 6.342 7.917 3 80.00 94.44 BKA-LightGBM 5.933 7.249 5 83.33 95.56 IBKA-LightGBM 5.345 5 6.827 8 85.56 96.67

(1)对实际生产数据进行处理后,分别建立了基于SVM、XGBoost、LightGBM的转炉炼钢终点温度预测模型.对比分析后,发现LightGBM模型预测效果最佳,因此,选用该模型验证其进一步实现优化的可行性.

(2)针对BKA后期易陷入局部最优困境以及LightGBM模型中重要参数的设置问题,提出了一种融合正弦余弦算法和柯西-高斯变异策略的改进算法即IBKA,并将其与5种智能算法(JAYA、GWO、WOA、RBMO、BKA)进行仿真对比分析.结果表明,IBKA具有更快的收敛速度和更高的预测精度,并能迅速找到全局最优解.

(3)将IBKA应用于LightGBM模型,获得IBKA-LightGBM转炉炼钢终点温度预测模型,提高了对转炉炼钢终点温度的预测精度.分别将5种智能算法(JAYA、GWO、WOA、RBMO、BKA)应用于LightGBM建立对比模型,结果表明:IBKA-LightGBM模型的预测值与实际值的误差在±10℃和±15℃下的命中率分别为85.56%和96.67%,平均绝对误差为5.345 5,均方根误差为6.827 8;与其他5种模型相比,IBKA-LightGBM模型取得了更好的预测效果.

(4)IBKA-LightGBM转炉炼钢终点温度预测模型可通过自带的可视系统或并行系统与现有的炼钢控制系统进行集成,协同作用,为现场生产提供操作指导,同时可为后续的转炉炼钢补吹优化奠定基础.但因现场数据实时更新,模型也需要同步调整,这也为下一步的研究方向提供了思路.

[1] 高闯,沈明钢.基于无约束小波权重TSVR的转炉炼钢终点静态预测模型[J] .炼钢,2019,35(2):20-24.(Gao Chuang,Shen Minggang.End-point static prediction of BOF steelmaking based on unconstrained wavelet weighted twin support vector regression[J] .Steelmaking,2019,35(2):20-24.)

[2] 许刚,雷洪波,李惊鸿,等.转炉炼钢终点控制技术[J] .炼钢,2011,27(1):66-70.(Xu Gang,Lei Hongbo,Li Jinghong,et al.End-point control techniques for converter steel-making[J] .Steelmaking,2011,27(1):66-70.)

[3] 刘闯,韩敏,王心哲.基于膜算法进化极限学习机的氧气转炉炼钢终点预报模型[J] .大连理工大学学报,2014,54(1):124-130.(Liu Chuang,Han Min,Wang Xinzhe.Endpoint prediction modelfor basic oxygen furnace steelmaking based on membrane algorithm evolving extreme learning machine[J] .Journal of Dalian University of Technology,2014,54(1):124-130.)

[4] 李星彤,龚伟,李帝阅.基于Boosting算法的转炉终点预测模型[J/OL] .材料与冶金学报.(2024-04-09)[2024-12-06] .https://link.cnki.net/urlid/21.1473.TF.20240407.1828.002.(Li Xingtong,GongWei,LiDiyue.Endpoint prediction model of converter based on Boosting algorithm[J/OL] .Journal of Materials and Metallurgy.(2024-04-09)[2024-12-06] .https://link.cnki.net/urlid/21.1473.TF.20240407.1828.002.)[编辑部补录:李星彤,龚伟,李帝阅.基于Boosting算法的转炉终点预测模型[J] .材料与冶金学报,2025,24(6):589-596.(Li Xingtong,GongWei,LiDiyue.Endpoint prediction model of converter based on Boosting algorithm[J] .Journal of Materials and Metallurgy,2025,24(6):589-596.)]

[5] 张聪聪,董文亮,季晨曦,等.基于机器学习算法的“全三脱”工艺转炉终点预测[J] .炼钢,2023,39(4):28-36.(Zhang Congcong,Dong Wenliang,Ji Chenxi,et al.Endpoint prediction of duplex process converter based on machine learning algorithm[J] .Steelmaking,2023,39(4):28-36.)

[6] 马晓君,沙靖岚,牛雪琪.基于LightGBM算法的P2P项目信用评级模型的设计及应用[J] .数量经济技术经济研究,2018,35(5):144-160.(Ma Xiaojun,Sha Jinglan,Niu Xueqi.An empirical study on the credit rating of P2P projects based on LightGBM algorithm[J] .The Journal of Quantitative&Technical Economics,2018,35(5):144-160.)

[7] 杨仕存,魏志强,钟良才,等.基于数据驱动的转炉耗氧量模型研究[J] .炼钢,2022,38(4):7-13.(Yang Shicun,Wei Zhiqiang,Zhong Liangcai,et al.Study on oxygen consumption model based on data drive in a converter[J] .Steelmaking,2022,38(4):7-13.)

[8] 张莉,张小庆,孙民民,等.蝴蝶搜索与动态反向学习柯西变异的白鲸优化算法[J] .计算机工程与应用,2025,61(10):96-110.(Zhang Li,Zhang Xiaoqing,Sun Minmin,et al.Beluga whale optimization algorithm based on butterfly search and dynamic inverse learning cauchy variation[J] .Computer Engineering and Applications,2025,61(10):96-110.)

[9] Ke G L,Meng Q,Finley T,et al.LightGBM:a highly efficient gradient boosting decision tree[C] //Neural Information Processing Systems.Long Beach:NIPS,2017:1-9.

[10] Wang J,Wang W C,Hu X X,et al.Black-winged kite algorithm:a nature-inspired meta-heuristic for solving benchmark functions and engineering problems[J] .Artificial Intelligence Review,2024,57(4):98.

[11] 周建新,侯自川,李忠泽.融合多策略改进的黑翅鸢优化算法[J] .电子测量技术,2024,47(22):104-110.(Zhou Jianxin,Hou Zichuan,Li Zhongze.Black-winged kite optimization algorithm with multi-strategy improvement[J] .Electronic Measurement Technology,2024,47(22):104-110.)

[12] 毛清华,张强,毛承成,等.混合正弦余弦算法和Lévy飞行的麻雀算法[J] .山西大学学报(自然科学版),2021,44(6):1086-1091.(Mao Qinghua,Zhang Qiang,Mao Chengcheng,et al.Mixing sine and cosine algorithm with Lévy flying chaotic sparrow algorithm[J] .Journal of Shanxi University(Natural Science Edition),2021,44(6):1086-1091.)

[13] 付华,刘昊.多策略融合的改进麻雀搜索算法及其应用[J] .控制与决策,2022,37(1):87-96.(Fu Hua,Liu Hao.Improved sparrow search algorithm with multi-strategy integration and its application[J] .Control and Decision,2022,37(1):87-96.)

[14] Fu S W,Li K,Huang H S,et al.Red-billed blue magpie optimizer:a novel metaheuristic algorithm for 2D/3D UAV path planning and engineering design problems[J] .Artificial Intelligence Review,2024,57(6):134.

Improved black-winged kite optimization algorithm-light gradient boosting machine model to predict converter steelmaking endpoint temperature

X